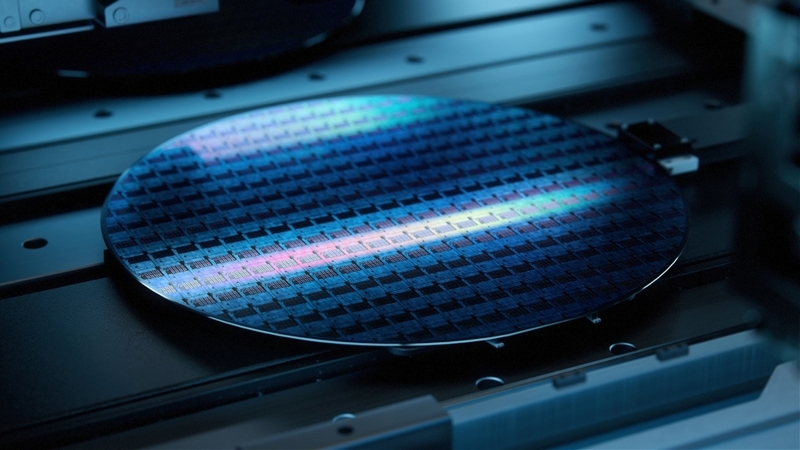

챗GPT를 시작으로 생성형 AI 수요가 급격히 증가하면서 주목받은 건 단연 엔비디아 GPU였다. 이와 동시에 GPU 메모리 성능을 담당하는 HBM(High Bandwidth Memory)이 또 하나의 블루오션으로 각광받고 있다. 이에 HBM 생산을 담당하는 삼성전자와 SK하이닉스의 행보에 업계의 관심이 쏠린다. 양사는 지속적인 기술 개발을 바탕으로 파트너십을 확대하고 생산량을 증대하는 데 집중하고 있다.

차세대 반도체 시장 이끌 HBM

HBM은 고대역폭 메모리 기술로, 특히 대용량 데이터를 처리해야 하는 AI 개발에서 중요성이 두드러진다. 이 기술은 D램보다 빠른 속도로 데이터를 처리하며, 3D 스택 메모리 구조를 사용해 칩 간에 더 많은 데이터 통로를 제공한다. 이는 메모리 칩을 수직으로 쌓아 올려 칩과 칩 사이의 거리를 최소화하고, 대역폭을 극대화하는 방식이다.

HBM의 특장점은 속도와 효율성이다. HBM은 그래픽 카드, 서버, 네트워킹 하드웨어 및 AI 계산과 같이 많은 양의 데이터를 빠르게 처리해야 하는 시스템에서 최선의 제품으로 자리잡고 있다. 구체적으로, HBM은 데이터 센터의 에너지 효율성을 향상시켜 운영 비용을 절감하는 데 기여한다. 무엇보다 이 기술은 AI와 머신러닝 분야에서 필요로 하는 대규모 데이터 처리와 분석 작업을 효율적으로 지원함으로써 기술 발전을 촉진시키는 핵심 요소다.

현재 HBM을 생산하는 기업은 세계에서 손꼽힌다. 대표적으로, SK하이닉스, 삼성전자, 마이크론이 있다. 트렌드포스 조사에 따르면, 지난해 HBM 시장 점유율은 SK하이닉스가 50%, 삼성전자가 40%, 마이크론이 10%였다고 밝혔다. 이 결과에 대해 삼성전자와 SK하이닉스 양사 간 신경전이 벌어지기도 했다. 대만 정보정책협의회 산하 산업정보연구소가 공개한 보고서에 따르면, 올해 4분기가 되면 SK·삼성·마이크론 등 3사가 내세우는 5세대 HBM인 HBM3E가 HBM 출하량의 50% 이상을 차지할 것이라고 전망했다.

치고 나가는 SK하이닉스 ‘손잡고 확장한다’

현재 HBM에서 가장 두각을 드러내는 기업은 단연 SK하이닉스다. 최근 SK하이닉스는 고객사로 엔비디아, 후공정 파트너로 TSMC와의 협업 구조를 완성하며 HBM 경쟁에서 한 발짝 앞섰다는 평가다. 엔비디아는 GPU용 HBM을 SK하이닉스에서 공급받고, TSMC에 패키징을 맡기는 방식으로 조달하고 있다. 지난 4월 SK하이닉스는 TSMC와 대만 타이베이에서 기술 협력을 위한 양해각서를 체결했다.

양사는 오는 2026년 양산 예정인 HBM4를 개발할 계획이다. 양사는 먼저 HBM 패키지 내 최하단에 탑재되는 베이스 다이 성능 개선을 추진할 것으로 보인다. SK하이닉스는 5세대 HBM인 HBM3E까지는 자체 D램 공정으로 베이스 다이를 만들었으나, HBM4부터는 TSMC가 보유한 로직 초미세 선단공정을 활용해 다양한 시스템 기능을 추가할 계획이다. SK하이닉스는 이를 통해 성능, 전력 효율 등에 대한 고객의 폭넓은 요구에 부합하는 맞춤형 HBM을 생산할 계획이라고 밝혔다.

SK하이닉스의 공정에 대한 막대한 투자도 주목할 만하다. 지난 4월 SK하이닉스는 인디애나주에 5조2000억 원을 투자해 HBM 생산 기지를 지을 계획이라고 발표했다. SK하이닉스는 인디애나주 웨스트라피엣에 AI 메모리용 첨단 패키징 생산 기지를 건설하고, 퍼듀대학교 등 현지 연구기관과 반도체 연구·개발에 협력할 계획이다.

이는 SK하이닉스의 첫 미국 공장으로, 2028년 하반기부터 차세대 HBM 등 AI 메모리를 양산할 것으로 보인다. 일각에서는 SK하이닉스가 미국 정부로부터 얼만큼의 보조금을 확보할 수 있을지가 관심사로 떠올랐다. 규정에 따르면, 인디애나 공장 건설로 받을 수 있는 보조금 규모는 최대 5억8050만 달러 수준인 것으로 알려졌다.

‘HBM 올인은 글쎄’ 시장 흐름 가늠하는 삼성전자

경쟁자인 SK하이닉스가 HBM 영역에서 발 빠르게 움직임에 따라, 삼성전자 역시 나름의 전략으로 응수하고 있다. SK하이닉스와 마찬가지로 삼성전자도 지난해보다 HBM 출하량을 늘리는 데 초점을 맞췄다. 지난 3월 미국 캘리포니아주에 마운틴뷰에서 열린 멤콘(MemCon) 2024에서 최대 2.9배로 늘릴 수 있음을 언급했다. 또한, 중장기 HBM 로드맵에서 2023년 출하량을 기준 2026년에 13.8배, 2028년에 23.1배 출하하겠다는 포부를 밝혔다.

최근 삼성전자의 개발 추이를 보면, 지난 2월에는 36GB 용량을 구현한 HBM3E 12H D램 개발에 성공했다. 삼성전자는 이 제품이 온도와 용량 측면에서 독보적이며, 첨단 열압착 비전도성 접착 필름(TC-NCF) 기술을 적용해 열 방출에서 높은 경쟁력을 갖췄다고 밝힌 바 있다. 삼성전자는 HBM3E를 상반기 양산할 예정이다. 이 제품에 대해 엔비디아 젠슨 황 CEO는 기대감을 표시하며, 향후 양사 협력에 대한 가능성을 남기기도 했다.

이처럼 지속적인 개발을 추진 중인 삼성전자는 AI 응용 확산을 고려한 HBM 수요에 대응하겠다고 밝혔다. DS부문에서 HBM을 담당하는 상품기획실 김경륜 상무는 사내 인터뷰에서 “초기 HBM 시장에서는 하드웨어의 범용성이 중요했지만, 미래에는 킬러 앱을 중심으로 서비스가 성숙하면서 하드웨어 인프라가 서비스별로 최적화되는 과정을 필연적으로 겪을 것”이라고 내다봤다. 또한, “데이터를 저장하는 코어 다이는 단일화하고, 패키지와 베이스 다이 다변화를 통해 대응할 예정”이라고 덧붙였다.

한편, 삼성전자의 무기는 HBM만 있는 게 아니다. 고성능·고용량 DDR5, 메모리 반도체를 연결해 데이터 처리 속도와 용량을 높이는 컴퓨트익스프레스링크(CXL) 등 다양한 포트폴리오를 앞세워 AI 시장을 주도하겠다는 전략을 취하고 있다. 이에 대다수의 전문가는 삼성전자가 HBM을 포함한 차세대 반도체 전략이 장기적인 실적 개선을 이룰 것으로 예측한다.

헬로티 서재창 기자 |