1노드에서 2노드, 4노드 확장 시 95~100%에 달하는 선형적 성능 확장성 보여

망고부스트가 글로벌 AI 벤치마크인 MLPerf Training v5.0에서 AMD Instinct MI300X GPU 기반 최초의 멀티노드 학습 결과를 공개했다. 이번 성과를 통해 망고부스트는 대규모 AI 모델 학습에서 확장성과 실용성을 입증하며 AI 인프라 시장에서의 입지를 강화했다.

데이터 센터에서 대규모 모델 학습을 안정적으로 운영하기 위해서는 고성능 연산력과 네트워크 병목 해소, 유연한 시스템 구성, 그리고 특정 벤더에 종속되지 않는 인프라가 필수적이다. 망고부스트는 이번 MLPerf 결과를 통해 이 같은 요구를 충족하는 솔루션을 제시하며 온프레미스와 클라우드 모두를 아우르는 인프라 유연성을 확보했다.

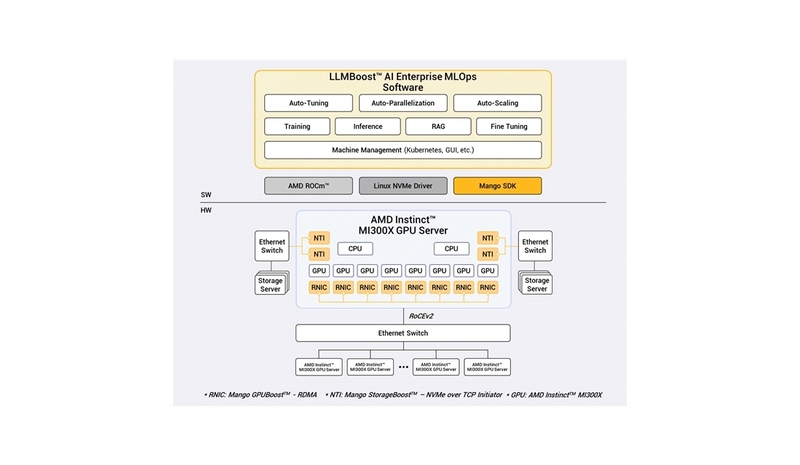

망고부스트는 자체 개발한 Mango LLMBoost 최적화 소프트웨어와 Mango GPUBoost RoCEv2 RDMA 네트워크 솔루션을 통해 Llama2-70B-LoRA 모델을 32개의 MI300X GPU로 10.91분 만에 파인튜닝하는 데 성공했다. 이는 MLPerf 기준 AMD GPU 기반 최초의 멀티노드 결과로, 1노드에서 2노드, 4노드로 확장할 때 95~100%에 달하는 선형적 성능 확장성을 보였다.

MLCommons의 대표 데이비드 캔터(David Kanter)는 “망고부스트의 첫 MLPerf 결과는 AMD GPU의 성능을 최대한 끌어낸 사례”라며, “소프트웨어 최적화가 현대 AI 가속기의 성능을 온전히 활용하는 데 핵심적임을 보여준다”고 평가했다.

Mango LLMBoost 소프트웨어는 모델 병렬 처리, 자동 튜닝, 배치 스케줄링, 메모리 최적화를 지원하며 다양한 LLM 학습에 최적화해 있다. 함께 제공되는 Mango GPUBoost RoCEv2 RDMA 네트워크 솔루션은 최대 3.2Tbps 대역폭과 수천 개 QP 환경에서도 안정적인 성능을 유지, 멀티노드 환경의 통신 병목 문제를 해결한다. 이번 MLPerf 결과 외에도 Llama2-7B, Llama3.1-8B 등 다양한 LLM에 대한 내부 벤치마크를 통해 유사한 확장 효율성을 확인했다. 이는 실제 데이터 센터 운영 환경에서도 동일한 성능을 기대할 수 있음을 시사한다.

망고부스트는 AMD ROCm 소프트웨어 스택과 긴밀히 통합해 MI300X GPU의 연산 성능과 메모리 용량, 대역폭을 극대화했다. AMD AI 성능 설계 엔지니어링 펠로우 미나 아루나찰람(Meena Arunachalam)은 “망고부스트의 MLPerf 결과는 AMD Instinct MI300X GPU와 ROCm 스택, 그리고 망고부스트의 소프트웨어 및 하드웨어 최적화 기술이 결합해 고성능 AI 인프라를 실현했음을 보여준다”고 밝혔다.

망고부스트 김장우 대표는 “이번 결과는 벤더 종속성 없이도 대규모 LLM 학습을 효율적으로 수행할 수 있음을 입증한 사례”라며, “AI 인프라의 효율성과 유연성을 극대화할 수 있는 해답을 제시했다”고 강조했다. 망고부스트는 앞으로 통신 최적화, 하이브리드 병렬 전략, 토폴로지 기반 스케줄링, 도메인 특화 하드웨어 가속 기술 등을 고도화해 분산형 AI 학습 성능의 한계를 극복할 계획이다.

헬로티 서재창 기자 |