앞 편에서 필자는 스마트 팩토리의 가장 중요한 특징 중 하나로 ‘유연성’을 꼽았다. 그리고 하나의 공정 라인에서 다양한 제품을 생산하는 ‘혼류생산’을 예로 들어 유연한 자동화 공정의 장점을 설명했다.

혼류생산의 핵심은 생산하는 제품이 바뀔 때마다 버튼 한 번만 누르면 전 공정이 자동으로 재구성될 수 있어야 하는 것이다. 하지만 수많은 하드웨어 기계장치가 복합된 생산라인에서 이런 기능을 구현하는 것은 쉬운 일은 아니다.

현재 유연한 생산 공정을 위해 도입한 수많은 로봇 시스템 또한 제품이 바뀔 때마다 오프라인으로 프로그램하여 경로를 수정할 수는 있지만 실시간으로 들어오는 제품에 따라 알아서 경로를 수정하지 못한다는 한계점이 있다. 이러한 한계를 극복하기 위해서 ‘로봇 비전’ 기술이 꼭 필요하다.

로봇 비전이란

‘비전(vision)’은 ‘눈, 시력, 시각’을 뜻하는 용어로, ‘로봇 비전’이란 ‘로봇의 눈’을 의미한다. 보통 로봇을 사용하기 위해서는 로봇의 움직임을 엔지니어가 일일이 미리 가르쳐 주어야 하는데, 이를 티칭(teaching) 작업이라고 한다.

하지만 로봇이 사람처럼 시각센서(카메라 또는 레이저)를 통해 환경이나 사물을 인식할 수 있게 되면, 작업 공간에 있는 대상물을 찾고 작업물의 위치와 방향을 계산할 수 있게 된다. 이러한 기능을 ‘로봇 비전(robot vision)’이라고 하고, 이렇게 계산된 작업물의 위치와 방향을 기준으로 로봇의 작업 경로를 실시간으로 계산하여 로봇을 제어하는 작업을 ‘로봇 가이던스(robot guidance)’라고 한다.

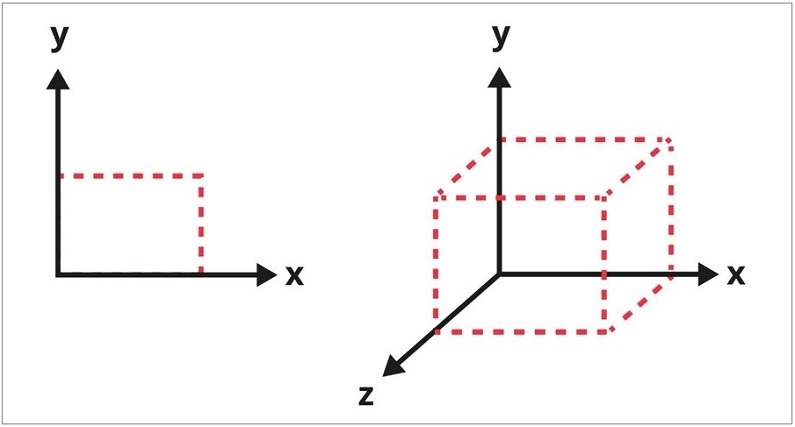

로봇 비전 기술은 크게 2D 비전과 3D 비전으로 나눌 수 있다. 기술적인 차이는 다음 편에서 더 자세히 설명하고 기능적인 차이를 간단히 설명하면 다음과 같다.

2D 비전은 2D 카메라의 작업 영역인 x-y 좌표 공간에서 데이터를 처리하여, 물체의 위치를 2D 평면상의 x-y 좌표로 계산하고, 물체의 자세를 평면 위의 회전 각(θ)으로 인식한다. 이에 반해 3D 비전은 3D 카메라의 작업 영역인 x-y-z 좌표 공간에서 데이터를 처리할 수 있어서, 물체의 위치를 3D 공간상의 x-y-z 좌표로, 물체의 자세를 공간상의 3D 회전각인 roll-pitch-yaw로 인식할 수 있다.

보통 공장에서 많이 사용하는 로봇팔은 관절이 여섯 개인 6축 수직 다관절 로봇이다. 관절이 여섯 개란 의미는 로봇팔에 달린 툴의 위치와 자세를 공간상에서 6자유도(x-y-z, roll-pitch-yaw) 전 방향으로 움직일 수 있다는 의미이다. 따라서 6축 로봇이 3D 로봇 비전을 사용할 때 공간상에 놓인 물체의 x-y-z 방향 위치뿐만 아니라 전방향으로 틀어진 자세까지 맞추어 작업을 할 수 있게 된다.

만약에 2D 비전을 사용하는 경우에는 평면 위에 놓인 물체의 x-y 위치 값과 한쪽 방향 회전 값만 인식할 수 있기 때문에 로봇은 ‘평면 위에 항상 같은 높이에 놓인 평평한 물체’만 작업할 수 있게 된다. 이런 경우는 보통 2D 평면 위에서 작업하는 직교로봇이나 스칼라 로봇을 사용하는 경우를 제외하고는 공간상의 임의로 놓인 작업물에 대한 작업을 정확하게 할 수가 없게 된다. 따라서 통상 6축 로봇의 ‘로봇 비전’이라 하면 3D 카메라를 사용하는 것을 조건으로 한다.

올바른 로봇 비전 사용을 위한 기술적 조건

로봇 비전을 올바르게 사용하기 위해서는 한 가지 기술적 조건이 더 필요하다. 그것은 사람에 비유하자면 눈과 손의 협응(eye-hand coordination)이라고 부르는 것으로, ‘눈과 손을 동시에 사용하는 활동을 할 수 있게 해주는 능력’을 말한다. 예를 들어 유아는 생후 4~5개월쯤부터 눈으로 보이는 것을 손 뻗어서 만질 수 있게 된다. 눈으로 보이는 물체가 얼마나 멀리 떨어져 있는지 뿐만 아니라 손을 얼마나 뻗어야 하는지도 동시에 익혀야 하는 것이다.

로봇은 아이처럼 실패를 통한 반복 학습을 할 수 없기 때문에 이 모든 작업을 정확한 계산을 통해 할 수 있어야 한다. ‘눈’을 단 로봇이 보이는 곳으로 정확히 움직일 수 있게 하려면, 카메라에서 보이는 물체의 좌표인 ‘카메라 기준 좌표 값’을 로봇 팔의 좌표인 ‘로봇 베이스 기준 좌표 값’으로 변환을 할 수 있어야 하고, 이러한 좌표 변환 작업을 위해서는 ‘카메라가 로봇 베이스를 기준으로 3D 공간상의 어디에 있는지’를 정확히 찾을 수 있어야 한다. 이 작업을 로봇-카메라 캘리브레이션(robot-camera calibration)이라고 한다.

따라서 ‘로봇 비전’ 기술이라고 하면 카메라가 어디에 있든지 로봇 베이스 좌표를 기준으로 그 위치를 정확히 찾을 수 있어야 하며, 카메라에서 찾은 물체의 좌표를 로봇 베이스 좌표 기준으로 변환하는 계산을 할 수 있어야 한다.

지게차가 크고 무거운 작업물을 나무 팔레트 위에 ‘꽝’하고 올려놓았다. 나무 팔레트는 조금 부서지기도 했다. 이렇게 팔레트 위에 아무렇게나 놓인 작업물이 연마작업을 하는 로봇 앞으로 옮겨져 왔다. 이런 상황에서는 작업물을 기계적으로 정위치 시킬 수 없으므로 로봇의 연마작업을 미리 티칭하는 것은 불가능하다. 팔레트 위에 놓인 작업물의 위치를 찾기 위해 다수의 카메라와 거리 측정 센서가 작업물 주위에 부착되어 있었다. 하지만 각 센서가 바라보는 관점에 따라 측정값의 기준이 다 다르므로 이 센서값들을 조합하여 작업물의 틀어진 정도를 정확히 찾기란 쉽지 않다. 많은 실험을 통해서 그 값을 계산했다고 하더라도 로봇에게 그대로 전달하면 측정값과 기준이 다른 로봇이 제대로 움직일 리 만무하다.

필자가 한 공장을 방문했을 때 이런 상태로 시스템의 문제 소지를 따지기 위해 비전 회사, 로봇 회사, 고객사 간 다툼이 일어난 상태였다. 원인은 ‘로봇 비전’에 대한 원리 이해가 부족한 상태로 잘못된 방식으로 비전 시스템을 설치했기 때문이었다. 우리 팀은 3D 카메라 한 대를 설치하고 로봇-카메라 캘리브레이션을 완료한 이후에 찾은 물체의 로봇 베이스 기준 좌표 값을 로봇에게 전달하였다. 그리고 이렇게 찾은 좌표를 기준으로 기존에 티칭한 로봇 연마 경로를 변환하고 로봇을 움직이자, 마법처럼 로봇이 정확히 아무렇게나 놓인 물체 위로 정확하게 연마작업을 수행하고 문제를 해결하였다.

로봇 비전은 공정의 유연성을 극대화 한다

3D 카메라를 이용한 ‘로봇 비전’을 정확히 사용하면 작업물이 바뀔 때마다 티칭을 수정할 필요가 없어진다. 또한, 동일한 작업물의 위치뿐만 아니라 어느 방향으로든 각도가 바뀌더라도 로봇이 그 위치와 자세의 변화량만큼 정확히 이동해서 작업을 수행한다. 이렇게 로봇 비전은 공간상에 6자유도로 자유자재로 움직일 수 있는 6축 로봇의 기능을 최대한 살리고 공정의 유연성을 극대화할 수 있다.

다음 편에서는 2D 비전과 3D 비전의 기술적인 원리와 그 차이에 대해 좀 더 자세히 살펴보고자 한다.